プエルトリコ協同組合の監督および保険公社の理事長(コセック)メイベル・ヒメネス・ミランダ氏は、協同組合における人工知能(AI)の導入は、人間による厳格な監督、適切な組織的管理、責任あるリスク管理の下で行われなければならないと警告した。

しかし、現時点では規制当局は不正行為を認識しておらず、人工知能の使用に関する報告も受けていない。 協同組合 コセック氏は監督の下でエル・ヌエボ・ディア氏に語った。

ヒメネス・ミランダ氏は、AIの実装はセキュリティ、組織の監督、規制遵守の明確な基準の下で実行されなければならないと主張した。

同時に同氏は、新しいテクノロジーが金融機関の業務プロセス、信用分析、リスク検出をサポートする役割を果たしていると認識した。

「 人工知能 プロセスを最適化し、機関のリスク管理能力を強化できます。ただし、その使用には人間による監督、組織の透明性、パートナーの情報と利益を保護する規制基準の遵守が伴わなければなりません」と同氏は述べた。

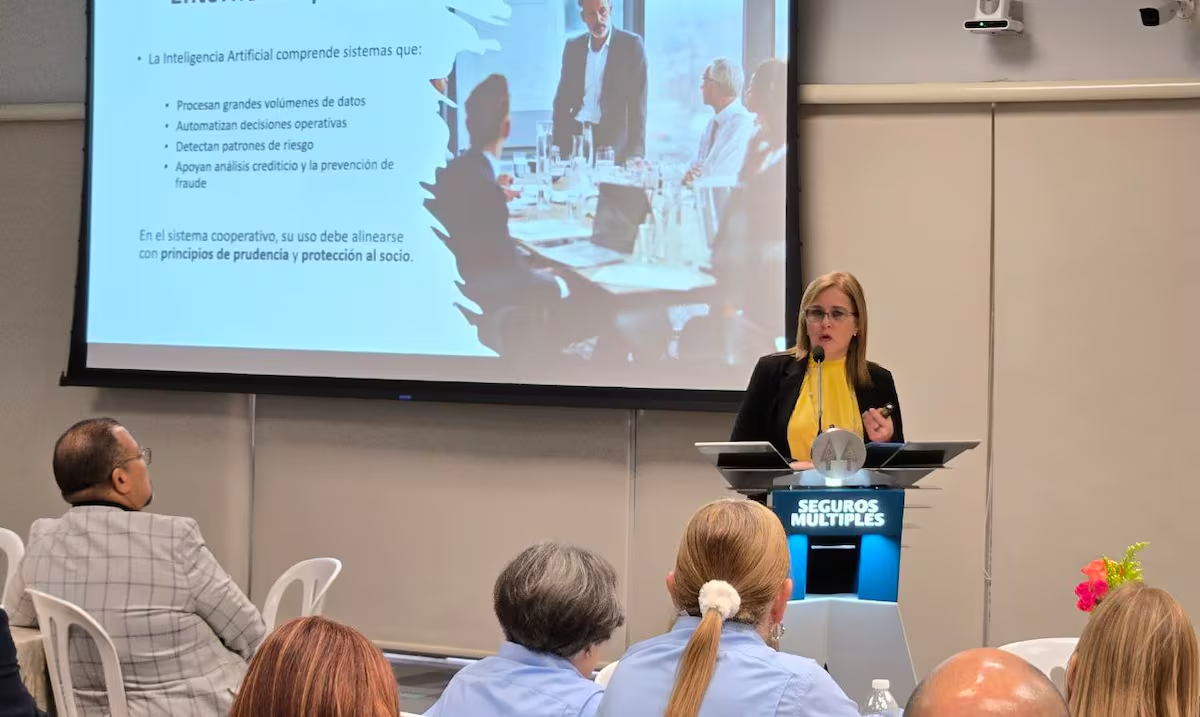

この表現は、倫理シンポジウムで発表されたものです。 プエルトリコ複数保険協同組合では、ヒメネス・ミランダが「人工知能の倫理基準と協同組合におけるその応用」と題したワークショップを開催しました。

同執行役員は、このメッセージは、先進的な技術ツールを採用する場合に、セキュリティ、リスク管理、パートナー情報の保護に関する明確な基準の下で確実に行われるようにするための予防戦略として生じたと明言した。

同当局者は、AIの使用は、情報セキュリティ、技術的リスク管理、サプライヤーの監督、インシデント通知に関する要件を定めた情報システムと技術に関する規則9741の規定に沿ったものでなければならないと指摘した。

同氏はまた、100万人以上の組合員にサービスを提供するプエルトリコの協同組合システムは、技術革新と適切な制度的管理および責任あるリスク管理を引き続き統合する必要があると指摘した。

ヒメネス・ミランダ氏は、「テクノロジーによってプロセスを自動化できるが、パートナーの信頼を守る組織の責任は依然として人間にある」と強調した。